一、提出

循环神经网络(Recurrent Neural Networks,RNNs)的训练是通过反向对权值直接优化来实现的,这种方式容易产生两个问题:收敛速度慢和易陷入局部最优。回声状态网络( echo state network,ESN) 由 Jaeger于2001年提出,在模型构建与学习算法方面较传统的循环神经网络有较大差别,凭借不同于循环神经网络反向传播的形式进行学习,其相应的学习算法为递归神经网络的研究开启了新纪元。

回声状态网络又称储备池计算(RC,reservoir computing),采用由随机生成稀疏连接固定不变的内部权重矩阵得到神经元组成的储备池作为隐层,用以将输入进行投射到高维、非线性的表示。ESN将神经网络的隐层权值预先生成而非训练生成,与隐层至输出层的权值训练分开进行,其基本思想的前提是生成的储备池具有某种良好的属性,往往能够保证仅采用线性方法训练储备池至输出层的权值即可获得优良的性能。

二、基本原理

2.1 网络结构

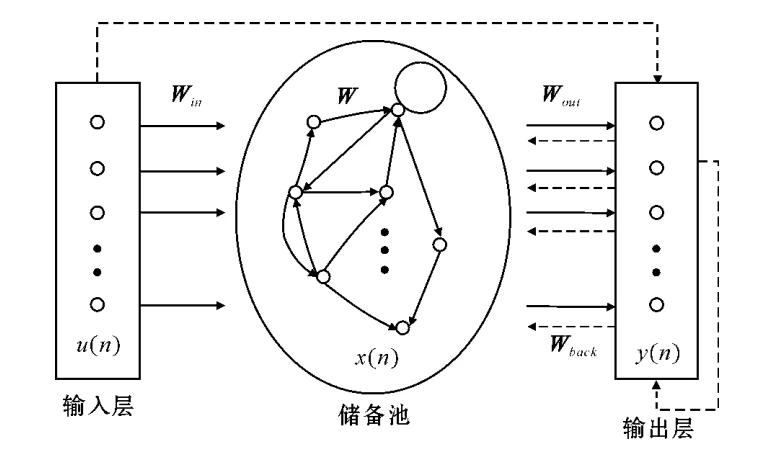

ESN拓扑结构图

基本方程:

预先生成Win(输入单元与储备池内部连接权值矩阵)、W(储备池内部连接权值矩阵)、Wback(储备池与输出单元连接权值矩阵),只训练Wout(储备池与输出单元连接权值矩阵)

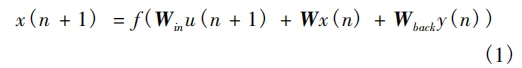

:储备池单元的激活函数

:储备池单元的激活函数

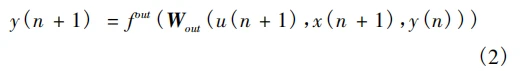

:输出单元的激活函数

:输出单元的激活函数

2.2 主要参数

2.2.1 储备池规模N

储备池其中神经元的个数N,常规来讲N值越大,预测的精度越高,但同时也会导致效率低下,容易过拟合。

2.2.2 储备池谱半径SR

SR是W最大特征值的绝对值,是影响储备池记忆能力的主要因素。一般需要保证SR<1,ESN才有回声状态性质,但后续研究逐步超越该界限,SR<1的要求不再严格。

2.2.3 储备池稀疏程度SD

SD是内部神经元的连接情况,表示储备池中相互连接的神经元占所有神经元总数的比例,通常为1%~5%。

2.2.4 输入单元尺度IS

IS是输入连接至储备池之前需要相乘的一个尺度因子。相乘使得输入信号变换至神经元激活函数相应的范围内。

2.3 构造方法

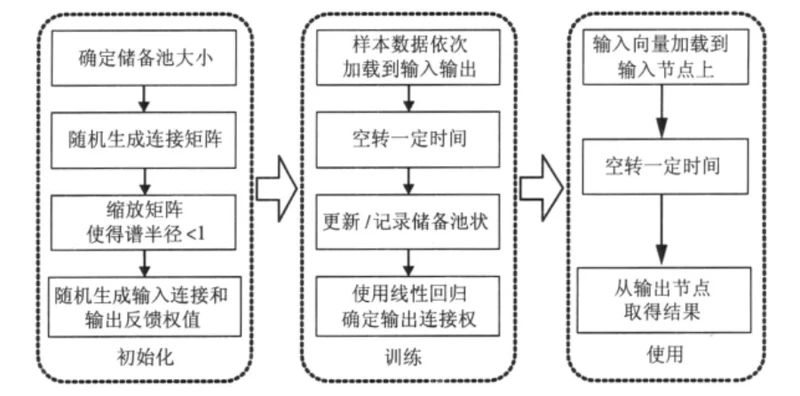

ESN的建立流程

(1)首先确定储备池的规模,即神经元的个数。节点数越多,拟合能力越强。由于ESN仅仅通过调整输出权值来线性拟合输出结果,所以一般ESN需要远大于常规神经网络的节点规模。

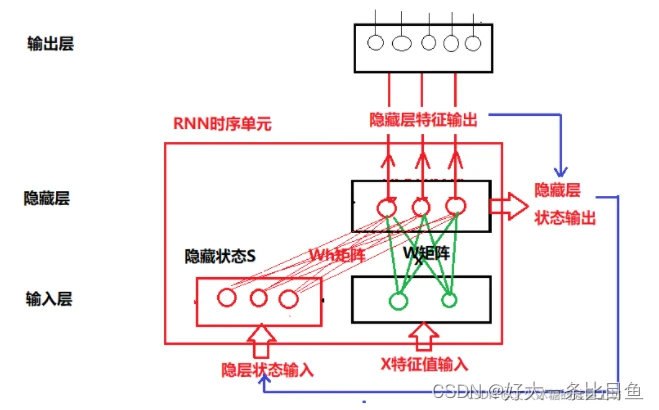

(2)随机生成连接矩阵W,这个矩阵表示了哪些神经元之间是有连接的,以及连接的方向和权值。此处往往使新接触ESN的同学存疑,并因此对ESN的储备池不太理解。事实上,内部权重矩阵是某时刻神经元与下一时刻神经元的连接,而非普通的互相连接,若对此有疑问,需回看循环神经网络,在此引用https://blog.csdn.net/HiWangWenBing/article/details/121387285,图片可供参考。

(3)其次是输入连接的权值大小以及内部连接矩阵的谱半径,这些关键参数会影响到网络短期记忆时间的长短,输入权值越小而内部矩阵的谱半径越接近1,网络短期记忆时间越长。但是增强记忆能力的同时,这种操作也造成了网络对“快速变化”系统建模能力下降。在实际应用中,要通过分析被建模系统的实际变化特征来选取相应的数值。

2.4 训练过程

2.4.1 采集状态

采样阶段即将输入数据经过输入连接权重、储备池、初始输出权重得到各个时刻的输出

y( n),在此阶段需要把储备池的内部状态不断收集,为后续的训练做准备。