原论文作者的介绍视频:https://www.bilibili.com/video/BV1H24y1q7hJ/

他这个论文是面向家用场景机器人的一个仿真环境

为了使机器人实现人类级别的感知和交互能力,我们可以通过与真实环境的交互来训练机器人,但是在现实世界中训练机器人不仅耗时耗力,而且也有很多的不稳定因素,所以一般训练都在仿真环境中进行

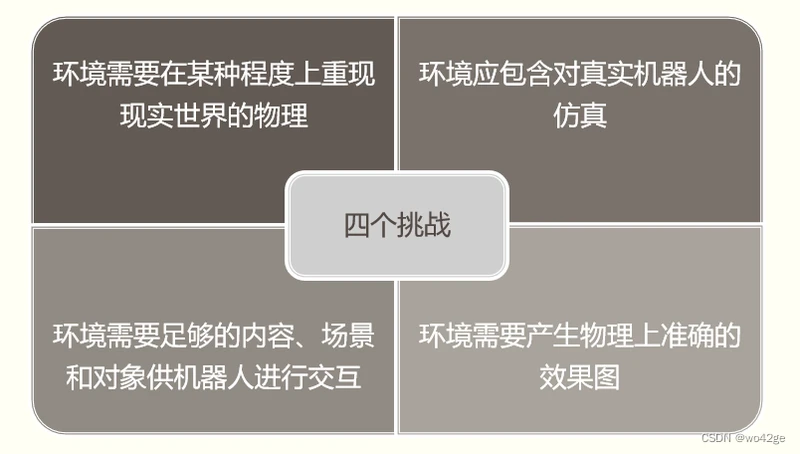

但是构建仿真环境主要面临以下四个挑战:首先是对物理规则的重现,但是完美重现是不太可能的,一般都是近似实现,第二点是仿真环境中的机器人应当与真实机器人行为与参数一致,这样才能训练后无缝过渡到现实世界,第三是环境需要产生物理上准确的效果图,以此来减轻视觉上的差距,最后是环境需要足够的内容、场景和对象供机器人进行交互

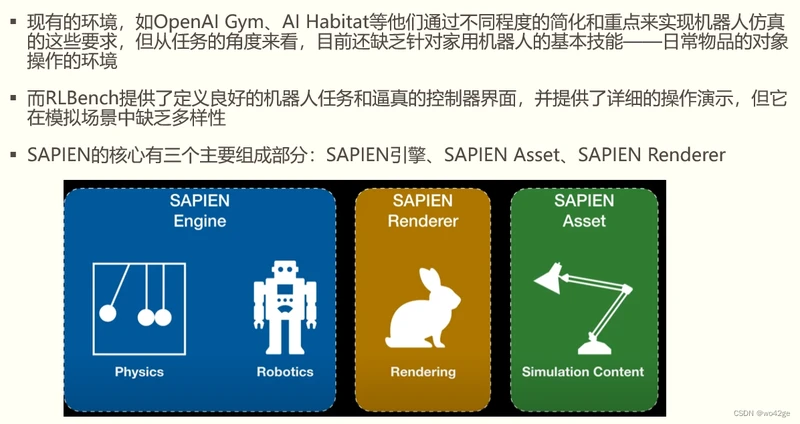

现有的一些仿真环境在不同程度上基本实现了这些要求,但是对于家庭里一些日常物品的对象和操作环境还比较欠缺,基于此作者提出了SAPIEN,它主要由三部分组成

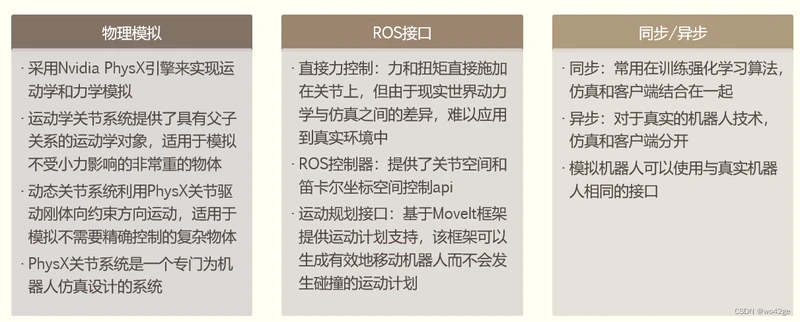

首先来介绍他的引擎,它采用了英伟达的physX引擎来进行物理模拟,并且提供了三种不同的关节系统,以适用于模拟不同的物体

对于ROS接口,他的API将机器人交互分为了三个层次,以满足研究人员对机器人运动的不同需求

然后就是同步和异步模式,同步模式中仿真和客户端结合在一起,异步模式下他们是分开的,在该模式下,模拟机器人和真实机器人的接口是相同的,这使得后期在进行迁移的时候不用做额外的设置

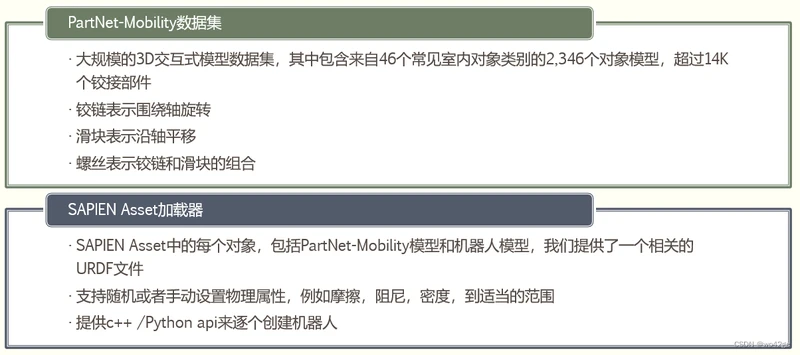

接下来是他的模拟的内容,里面包含有数据集和加载器

数据集中有2000多个对象模型,并且注释了3种类型的运动:一种是类似门的绕轴旋转,第二种是拉抽屉那种平移运动,第三种是类似与开瓶盖的那种操作

对于加载器,它里面提供了数据集中每个对象的URDF文件,同时也支持设置物理属性和手动添加机器人模型

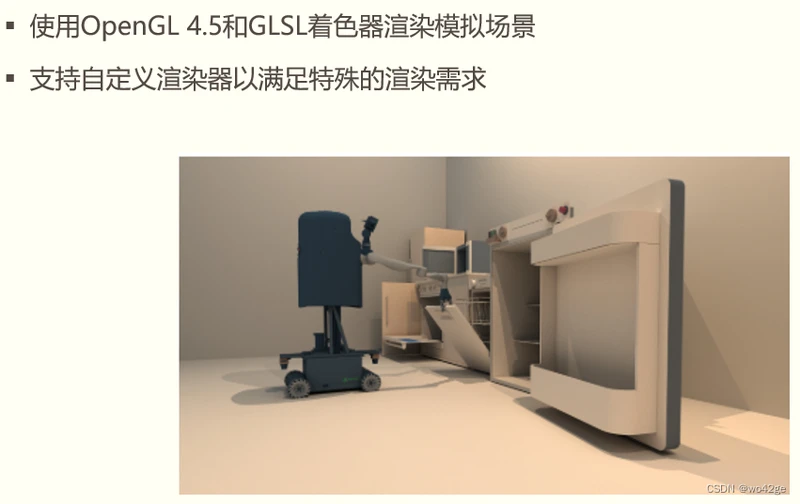

最后是它的渲染器,这里主要对颜色、光线等进行渲染,同时支持对渲染器进行替换

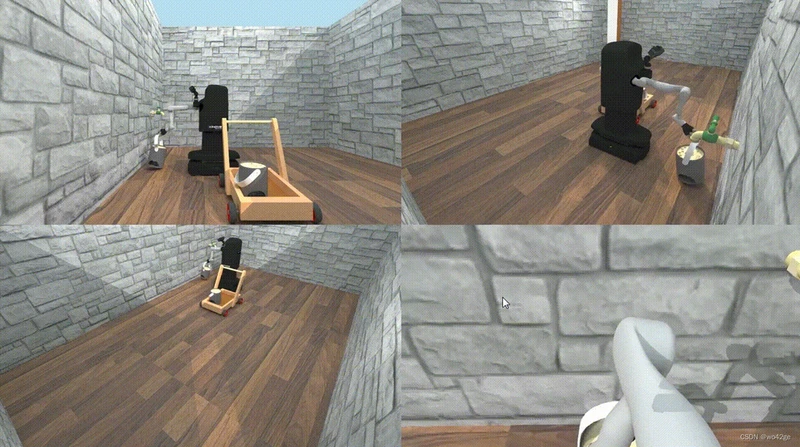

接下来作者在机器人感知和交互两个方面对SAPIEN进行演示

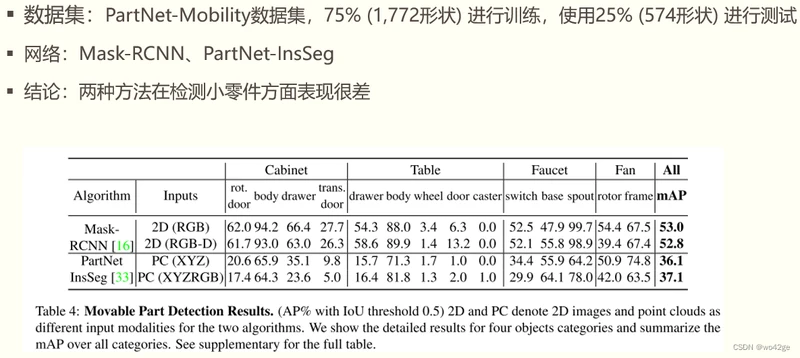

首先是机器人感知,在这里先演示了可移动零件检测任务,结果如下图所示,他们在小零件方面表现很差,像这个车轮、脚轮

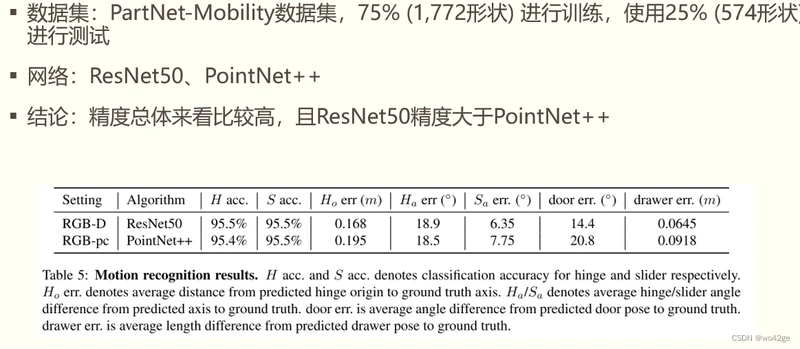

接下来演示了运动属性估计任务,数据集和前边一样,实验结果的精度总体来看比较高

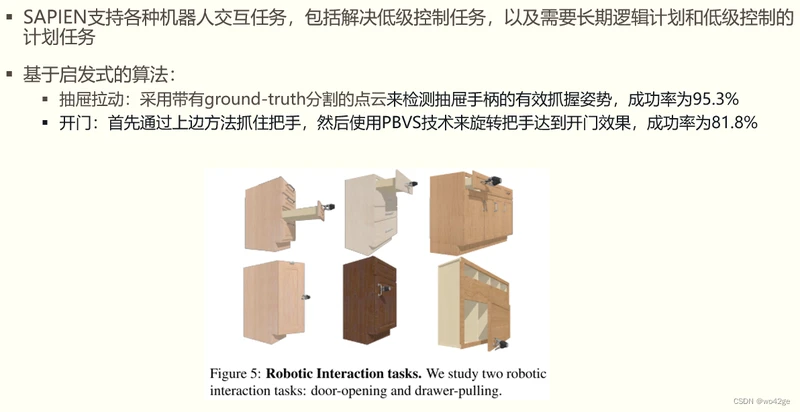

之后是机器人交互的演示,这里主要演示了拉抽屉和开门两种任务,基于启发式的算法,成功率还是比较高的,作者还采用了基于强化学习的方法,但是总体来说成功率比启发式算法要低